���������cAdam�������ı��^

�r�g��2025-02-20 ��Դ���A���hҊ

���������cAdam�������ı��^

�r�g��2025-02-20 ��Դ���A���hҊ

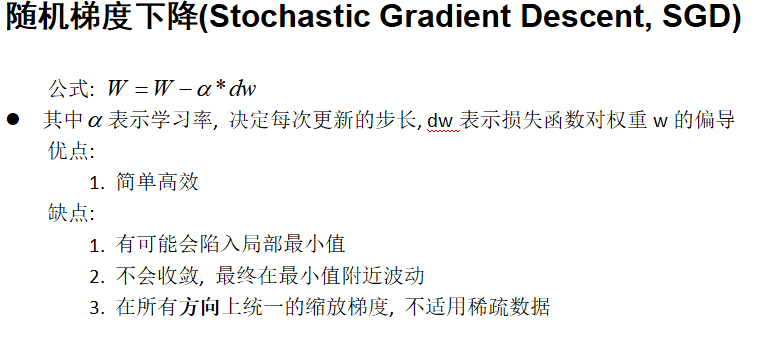

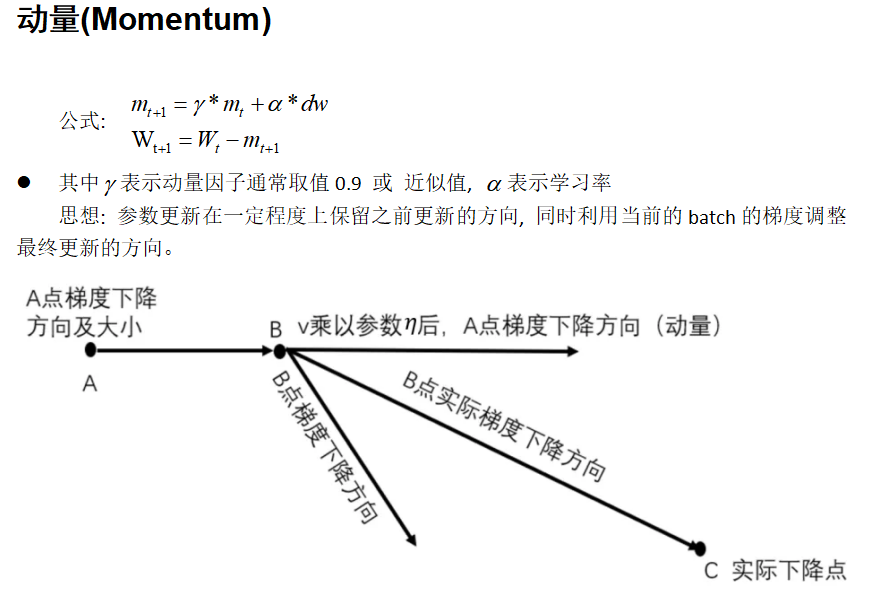

������(optimizer)

Ŀ��: ��С���pʧ����

�^�̣� �ڷ��������, �����W����(lr)�팦�����M�и��£���K���͓pʧ�����Ĵ�С, ʹ���W�jݔ������(�����M�ϵĸ���)

���c:

1. ǰ���ݶ�һ�r�܉���ٌW��

2. ǰ���ݶȲ�һ�r�܉�������ʎ, Խ�^�ֲ���Сֵ

ȱ�c:

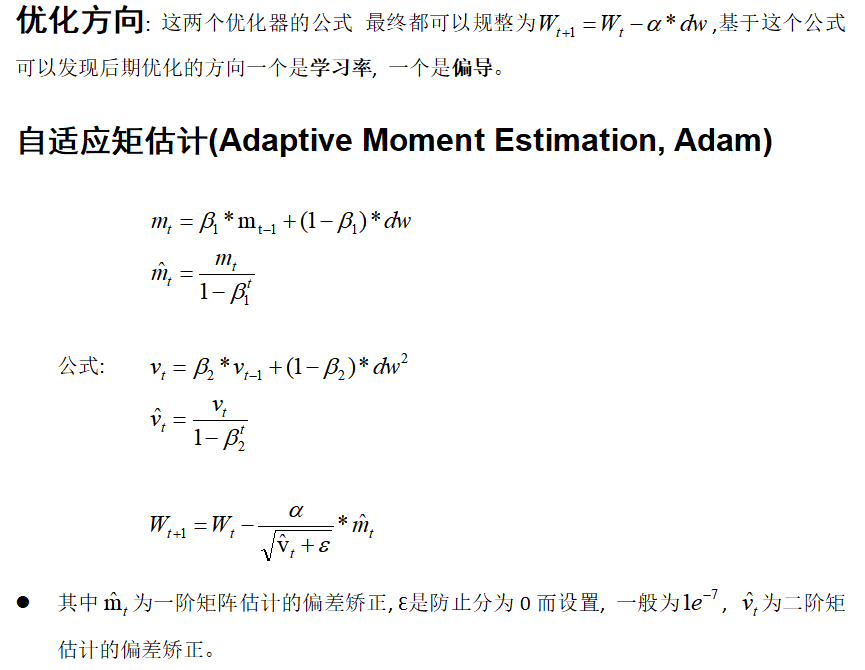

1. ����һ���~��ą��� y

˼��: �Y��Momentum��RMSprop�ɷN���������㷨, ������һ�A�ع�Ӌ�Ͷ��A�ع�Ӌ��

���c:

1. Adam�܉��Ԅ��{��ÿ�������ČW����, �܉�ܺõ�̎�����ͷ�ƽ����Ӗ������

2. ���^��������׃�W����(AdaGrad)�ă�����, �����Ӗ���ٶ�

���Y��

�����δ֪ģ�����M��Ӗ��, �����ȿ��]ʹ��Adam�_���pʧ�����܉��ҵ���Сֵ, ��ģ�͔M�ϵĺ����܉��Ք�,Ȼ���ГQ��SGD�M��Ӗ��, �����_��������ֵ��

�n�̷������A���hҊ��NXP�Ƴ�i.MX8M Plus�_�l�c���`

�n�̷������A���hҊ��NXP�Ƴ�i.MX8M Plus�_�l�c���` �n�̷���������HarmonyOSϵ�y�����W�_�l�����n�̣�

�n�̷���������HarmonyOSϵ�y�����W�_�l�����n�̣� �n�̷�����HaaS EDU K1�_�l�̳̣����n��ҕ�l��Դ�a��

�n�̷�����HaaS EDU K1�_�l�̳̣����n��ҕ�l��Դ�a�� �°�C�Z�Ծ���֮�����Z��ҕ�l�̳��ذ�ٛ�ͣ�Ƕ��ʽ��

�°�C�Z�Ծ���֮�����Z��ҕ�l�̳��ذ�ٛ�ͣ�Ƕ��ʽ�� �rֵ2000Ԫ��Ƕ��ʽ���b�̴̳�Y�����M�ͣ����㶮Ƕ��

�rֵ2000Ԫ��Ƕ��ʽ���b�̴̳�Y�����M�ͣ����㶮Ƕ�� �rֵ1000Ԫ������ARMϵ��ҕ�l������̳����r���t����

�rֵ1000Ԫ������ARMϵ��ҕ�l������̳����r���t���� �����¡�ARM�n���n�Ì�䛾��A��ҕ�l���M�Iȡ���Ⱥ�Դ

�����¡�ARM�n���n�Ì�䛾��A��ҕ�l���M�Iȡ���Ⱥ�Դ